本文來自申萬宏源研究的研報《人工智能芯片的競爭:GPU正紅,ASIC擁抱未來》,作者為證券分析師劉洋。

智通財經APP獲悉,申萬宏源研究發表研報,對人工智能各類芯片做出分析和對比,內容如下:

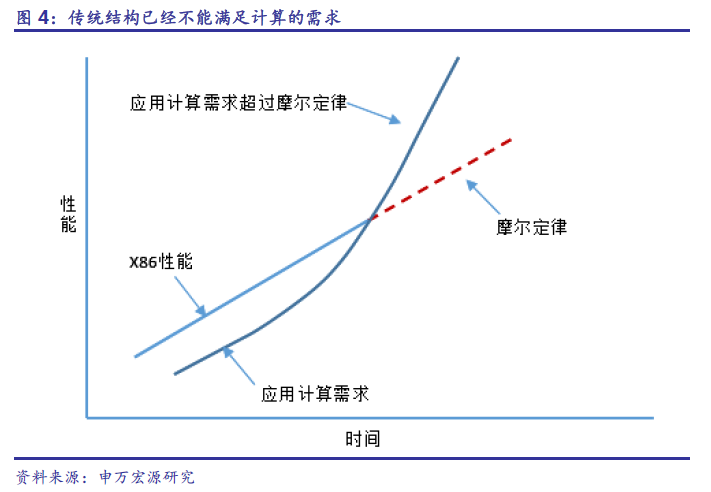

AI加速需求超過CPU計算能力摩爾定律供給

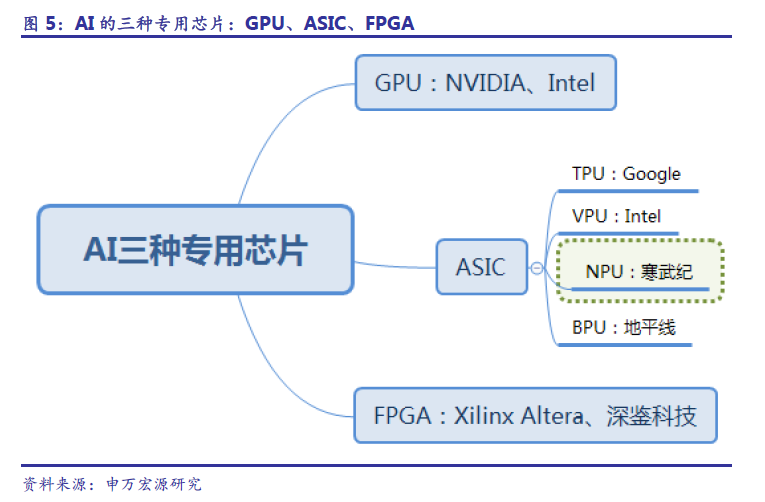

人工智能的三大支撐是硬件、算法和數據,其中硬件指的是運行AI算法的芯片與相對應的計算平臺。在硬件方面,目前主要是使用GPU並行計算神經網絡,同時,FPGA和ASIC也具有未來異軍突起潛能。

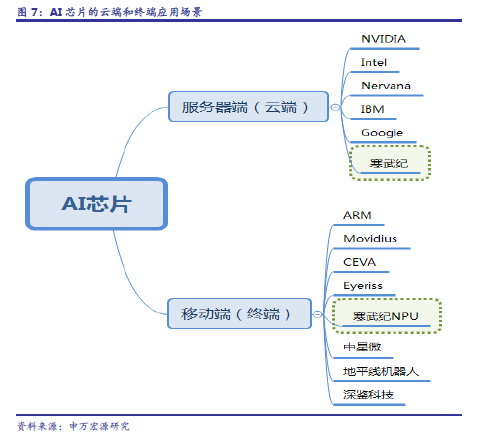

目前AI芯片按照使用場景可以分為:雲端(服務器端)和終端(移動端)芯片。雲端主要指公有云、私有云、數據中心等需要用到的神經網絡專用服務器,終端指手機、車載、安防、音響、機器人等移動應用終端。有的廠商同時具備雲端和終端芯片的設計能力。

機器學習不斷演進,深度學習出現。人工智能是應用範疇的詞彙,機器學習是目前最有效實現人工智能的方法。深度學習是機器學習的子類,也是現有機器學習方法中,最奏效的一類。

深度學習的人工神經網絡算法與傳統計算模式不同。傳統計算機軟件是程序員根據所需要實現的功能原理編程,輸入至計算機運行即可,其計算過程主要體現在執行指令這個環節。而深度學習的人工神經網絡算法包含了兩個計算過程:

1. 訓練:用已有的樣本數據去訓練人工神經網絡。

2. 執行:用訓練好的人工神經網絡去運行其他數據。

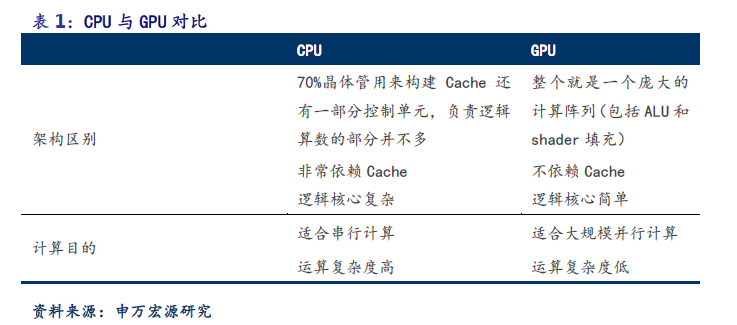

深度學習是目前AI 領域最有效算法,深度學習模型需要通過大量的數據訓練才能獲得理想的效果,CPU優勢為處理各類數據及強邏輯判斷能力,解決單次複雜問題能力強。兩者需求並非完全匹配,深度學習需要一種替代硬件來滿足海量數據的運算需求。

除了CPU以外,AI使用的主流芯片種類有: GPU、FGPA、ASIC。

GPU將最早受益於安防等需求爆發

GPU是較成熟生態系統,最先受益人工智能爆發。GPU與CPU類似,只不過是一種專門進行圖像運算工作的微處理器。GPU是專為執行復雜的數學和幾何計算而設計的,這些計算是圖形渲染所必需的。GPU在浮點運算、並行計算等部分計算方面可以提供數十倍乃至於上百倍於CPU的性能。英偉達公司從2006 年下半年已經開始陸續推出相關的硬件產品以及軟件開發工具,目前是人工智能硬件市場的主導。

GPU作為圖像處理器,設計初衷是為了應對圖像處理中需要大規模並行計算。因此,其在應用於深度學習算法時,有三個方面的侷限性:

1. 應用過程中無法充分發揮並行計算優勢。深度學習包含訓練和應用兩個計算環節,GPU在深度學習算法訓練上非常高效,但在應用時一次性只能對於一張輸入圖像進行處理,並行度的優勢不能完全發揮。

2. 硬件結構固定不具備可編程性。深度學習算法還未完全穩定,若深度學習算法發生大的變化,GPU 無法像FPGA 一樣可以靈活的配置硬件結構

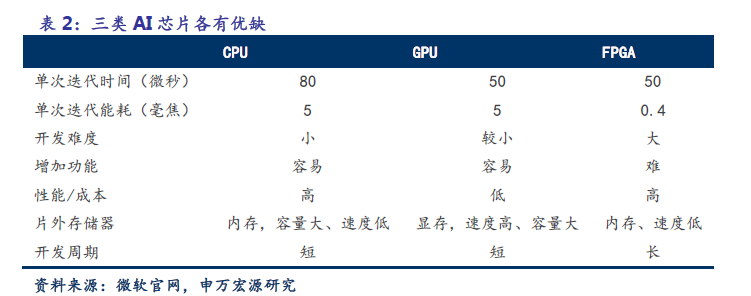

3. 運行深度學習算法能效遠低於FPGA。學術界和產業界研究已經證明,GPU計算方式與深度學習算法並非完全匹配,性能峯值無法被完全利用。運行深度學習算法中實現同樣的性能,GPU所需功耗遠大於FPGA。

FPGA:能效居中的中間方案

FPGA是能效中等、靈活度高、成本較高的AI白板。FPGA稱為現場可編程門陣列,用户可以根據自身的需求進行重複編程。FPGA比GPU具有更低的功耗,比ASIC具有更短的開發時間和更低的成本。目前來看,FPGA在兩個領域的應用前景十分巨大:工業互聯網領域、工業機器人設備領域。

作為未來製造業發展的方向,工業大數據、雲計算平臺、MES系統等都是支持工業智能化的重要平臺,它們需要完成大數據量的複雜處理,FPGA在其中可以發揮重要作用。

FPGA與GPU、CPU相比,具有性能高、能耗低、可硬件編程的特點。儘管FPGA 倍受看好,甚至新一代百度大腦也是基於FPGA 平臺研發,微軟、IBM 等公司都有專門的FPGA團隊為服務器加速,但其畢竟不是專門為了適用深度學習算法而研發,實際仍然存在不少侷限:

1. 基本單元的計算能力有限。為了實現可重構特性,FPGA 內部有大量極細粒度的基本單元,但是每個單元的計算能力(主要依靠LUT 查找表)都遠遠低於CPU和GPU中的ALU模塊。

2. 速度和功耗有待提升。相對專用定製芯片ASIC,FPGA 在處理速度和功耗方面仍然存在不小差距。

3. FPGA價格相對較為昂貴。在規模放量的情況下單塊FPGA 的成本要遠高與ASIC,因此FPGA 更適用於企業級用户,尤其是重配置、性能需求較高的軍工和工業電子領域。

ASIC:能效頂級、擁抱未來

ASIC 是一種為專門目的而設計的集成電路,功能特定的最優功耗AI 芯片,專為特定目的而設計。不同於GPU 和FPGA 的靈活性,定製化的ASIC一旦製造完成將不能更改,所以初期成本高、開發週期長的使得進入門檻高。目前,大多是具備AI 算法又成就夢想擅長芯片研發的巨頭參與,如Google的TPU。

ASIC 的另一個未來發展是類腦芯片。類腦芯片是基於神經形態工程、借鑑人腦信息處理方式,適於實時處理非結構化信息、具有學習能力的超低功耗芯片,更接近人工智能目標。由於完美適用於神經網絡相關算法,ASIC在性能和功耗上都要優於GPU FPGA,TPU1 是傳統GPU性能的14-16倍,NPU是GPU的118 倍。寒武紀已發佈對外應用指令集,預計ASIC將是未來AI 芯片的核心。

GPU在訓練層應用廣泛,ASIC在執行層表現較好。GPU、TPU 和NPU,適合的人工智能操作也不同。不同種類的芯片適用於不同的場景。

寒武紀終端閃耀、雲端推進

目前AI芯片按照使用場景可以分為:雲端(服務器端)和終端(移動端)芯片。雲端AI芯片類似於超級計算機,終端AI芯片更偏重能耗。先發優勢與浮點計算峯值決定GPU目前在雲端處於主導地位。

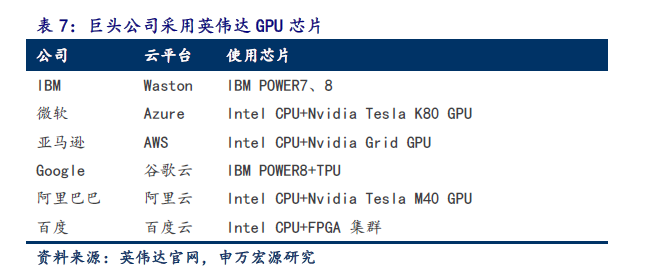

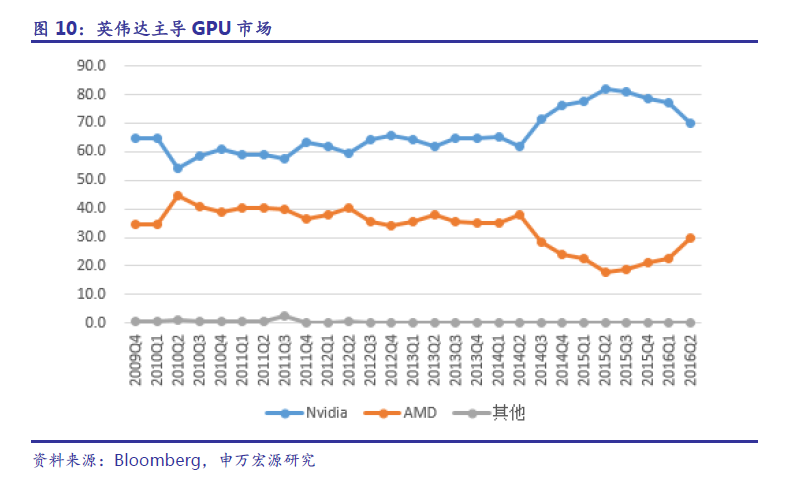

產品持續迭代,英偉達壟斷GPU市場。英偉達佔據全球GPU超過70%的市場份額,GPU產品佔據公司2016年84%的收入來源。

寒武紀在ASIC全面領先,指令集是殺手鐗創新,終端應用逐步增強,NPU已形成事實上落地。

手機是最重要的移動終端產品,蘋果的iPhone X採用的A11就是基於神經網絡的芯片“Bionic 神經引擎”,其Face ID的面部數據都由該芯片處理。華為於2017年9月發佈了全球首款移動端AI 芯片麒麟970,並應用在Mate 10手機中,這是華為和寒武紀深度合作,集成了專用於神經網絡的NPU。

根據華為公佈的測試數據,在處理相同的AI應用任務時,麒麟970的HiAI異構計算架構擁有大約50倍能效和25倍性能優勢。9月4日,有媒體披露了中科院發給華為的賀信,稱寒武紀公司研製並具有自主知識產權的“寒武紀1A深度學習處理器”,在人工智能應用上達到了4核CPU25倍以上的性能和50倍以上的能效。此次,麒麟970芯片集成寒武紀1A處理器作為其核心人工智能處理單元,實現了手機上本地、實時、高效的智能處理。(編輯:胡敏)